KI-Modelle in Mikrocontroller quetschen

Was erhalten Sie, wenn Sie KI mit dem IoT kreuzen? Die künstliche Intelligenz der Dinge (AIoT) ist die einfache Antwort, aber Sie erhalten auch ein riesiges neues Anwendungsgebiet für Mikrocontroller, das durch Fortschritte bei neuronalen Netzwerktechniken ermöglicht wird, die bedeuten, dass maschinelles Lernen nicht mehr auf die Welt der Supercomputer beschränkt ist. Heutzutage können (und werden) Smartphone-Anwendungsprozessoren KI-Inferenzen für die Bildverarbeitung, Empfehlungsmaschinen und andere komplexe Funktionen durchführen.

Diese Art von Fähigkeiten in den bescheidenen Mikrocontroller zu bringen, stellt eine große Chance dar. Stellen Sie sich ein Hörgerät vor, das mit KI Hintergrundgeräusche aus Gesprächen filtern kann, Smart-Home-Geräte, die das Gesicht des Benutzers erkennen und zu seinen personalisierten Einstellungen wechseln können, und KI-fähige Sensorknoten, die mit kleinsten Batterien jahrelang betrieben werden können. Die Verarbeitung der Daten am Endpunkt bietet Latenz-, Sicherheits- und Datenschutzvorteile, die nicht ignoriert werden können.

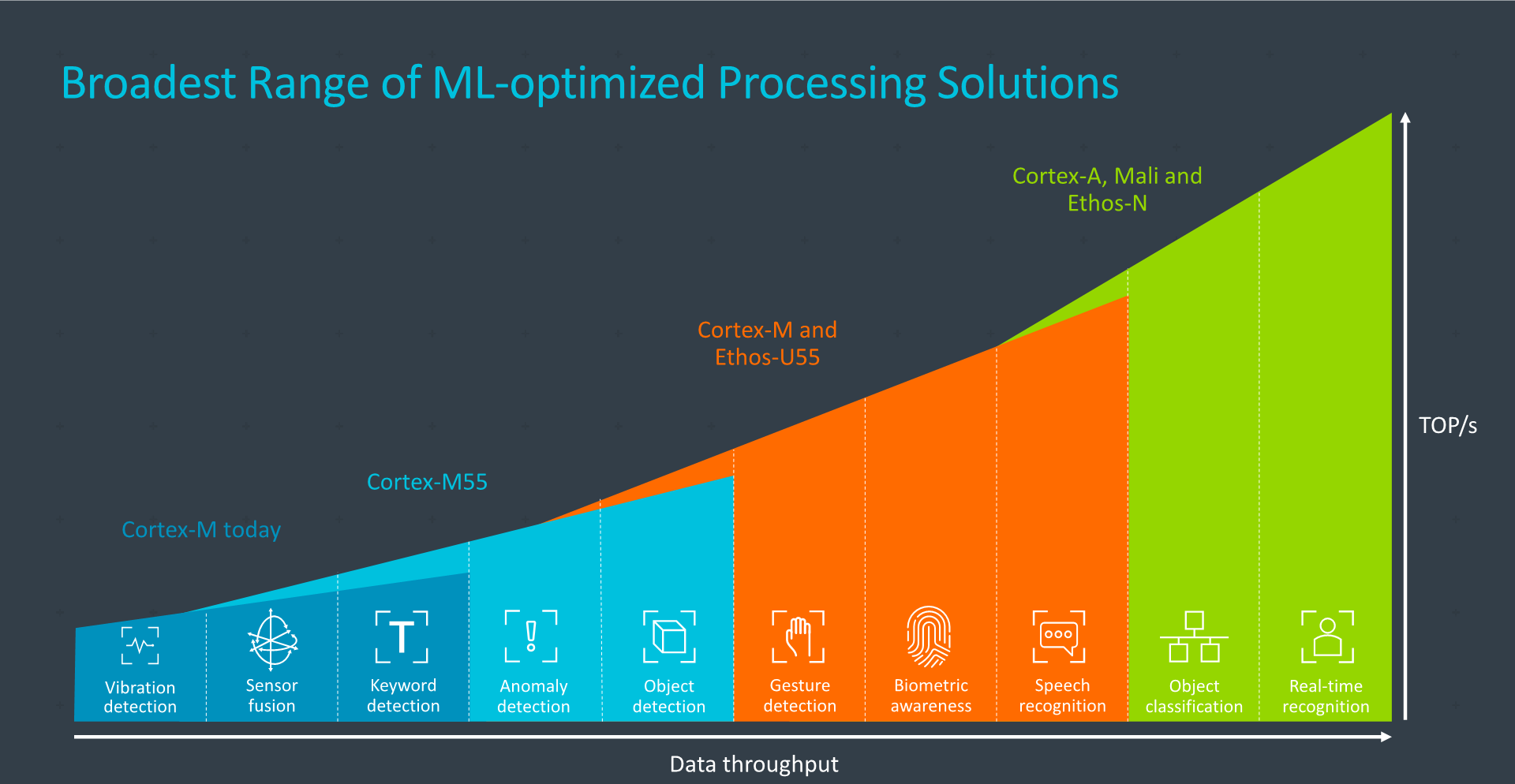

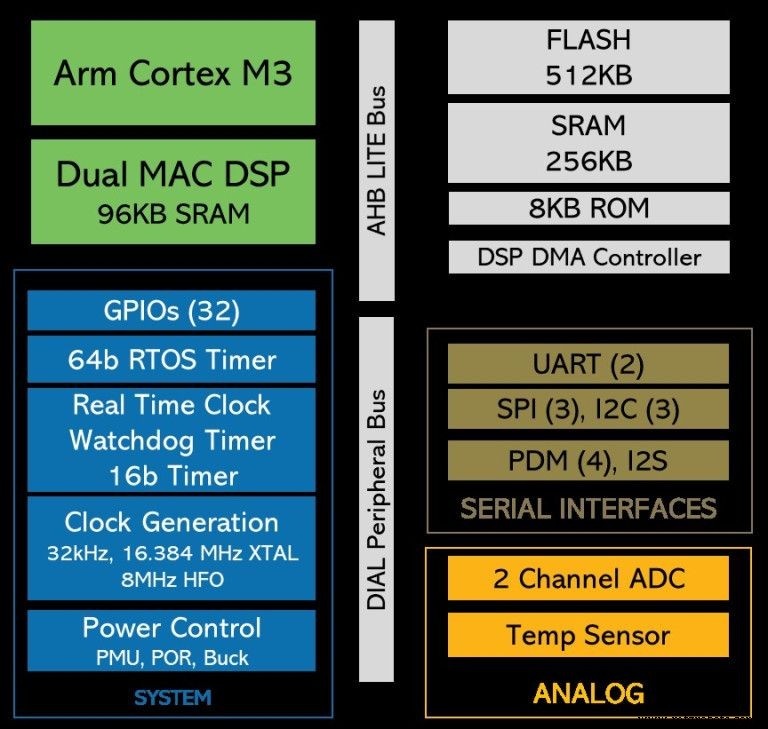

Im Tandembetrieb bieten Arms Cortex-M55 und Ethos-U55 genügend Rechenleistung für Anwendungen wie Gestenerkennung, Biometrie und Spracherkennung ( Bild:Arm)

Ein sinnvolles maschinelles Lernen mit Geräten auf Mikrocontroller-Ebene zu erreichen, ist jedoch keine leichte Aufgabe. So ist beispielsweise der Speicher, ein wichtiges Kriterium für KI-Berechnungen, oft stark eingeschränkt. Aber die Datenwissenschaft schreitet schnell voran, um die Modellgröße zu reduzieren, und Geräte- und IP-Anbieter reagieren darauf, indem sie Tools entwickeln und Funktionen integrieren, die auf die Anforderungen des modernen maschinellen Lernens zugeschnitten sind.

TinyML hebt ab

Als Zeichen für das schnelle Wachstum dieser Branche wird der TinyML Summit, eine neue Branchenveranstaltung im Februar im Silicon Valley, immer erfolgreicher. Der erste Gipfel, der letztes Jahr stattfand, hatte 11 Sponsoring-Unternehmen; die diesjährige Veranstaltung hatte 27 und die Slots waren laut den Organisatoren viel früher ausverkauft. Die Teilnahme an TinyMLs globalen monatlichen Treffen für Designer ist dramatisch gestiegen, sagten die Organisatoren.

„Wir sehen eine neue Welt mit Billionen intelligenter Geräte, die durch TinyML-Technologien ermöglicht werden, die gemeinsam erfassen, analysieren und autonom agieren, um eine gesündere und nachhaltigere Umwelt für alle zu schaffen“, sagte Qualcomm Senior Director Evgeni Gousev, Co-Vorsitzender des TinyML-Komitees , in seinen einleitenden Bemerkungen auf einer kürzlich stattgefundenen Konferenz.

Gousev führte dieses Wachstum auf die Entwicklung energieeffizienterer Hardware und Algorithmen in Kombination mit ausgereifteren Softwaretools zurück. Unternehmens- und Venture-Capital-Investitionen nehmen ebenso zu wie Startup- und M&A-Aktivitäten, stellte er fest.

Heute ist das TinyML-Komitee der Ansicht, dass die Technologie validiert wurde und dass erste Produkte, die maschinelles Lernen in Mikrocontrollern verwenden, in zwei bis drei Jahren auf den Markt kommen sollten. Von „Killer-Apps“ wird angenommen, dass sie drei bis fünf Jahre entfernt sind.

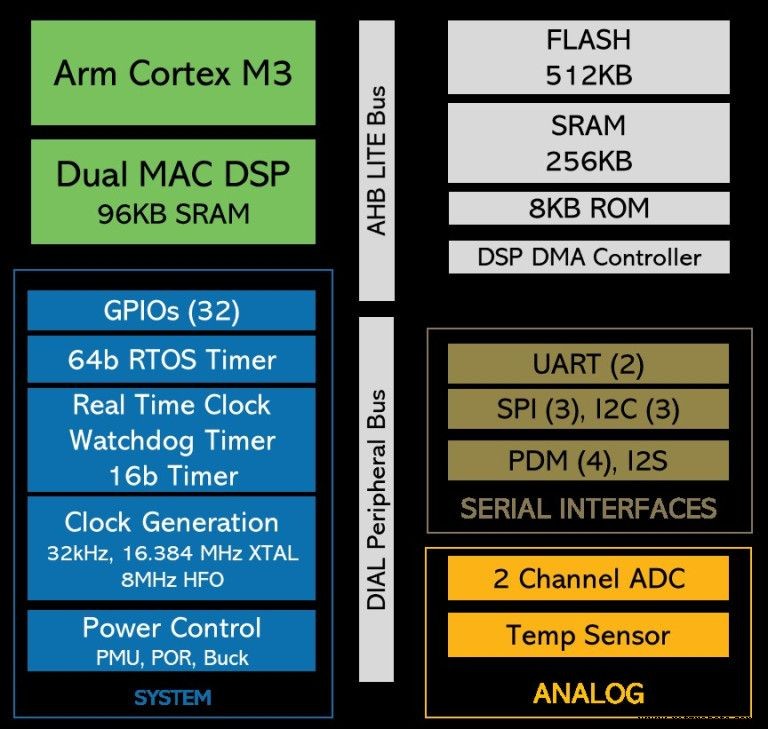

Ein großer Teil der technischen Validierung erfolgte im vergangenen Frühjahr, als Google zum ersten Mal eine Version seines TensorFlow-Frameworks für Mikrocontroller vorstellte. TensorFlow Lite für Mikrocontroller ist für die Ausführung auf Geräten mit nur Kilobyte Arbeitsspeicher ausgelegt (die Kernlaufzeit passt in 16 KB auf einem Arm Cortex-M3; mit genügend Operatoren, um ein Sprachschlüsselworterkennungsmodell auszuführen, benötigt es insgesamt 22 KB ). Es unterstützt Inferenz, aber kein Training.

Große Spieler

Die großen Mikrocontroller-Hersteller beobachten natürlich mit Interesse die Entwicklungen in der TinyML-Community. Da die Forschung es ermöglicht, neuronale Netzmodelle zu verkleinern, werden die Möglichkeiten größer. Die meisten bieten eine Art Unterstützung für maschinelle Lernanwendungen. STMicroelectronics verfügt beispielsweise über ein Erweiterungspaket, STM32Cube.AI, das die Abbildung und Ausführung neuronaler Netze auf seiner STM32-Familie von Arm Cortex-M-basierten Mikrocontrollern ermöglicht.

Die e-KI-Entwicklungsumgebung von Renesas Electronics ermöglicht die Implementierung von KI-Inferenz auf Mikrocontrollern. Es übersetzt das Modell effektiv in eine Form, die im e2-Studio des Unternehmens verwendbar ist und mit C/C++-Projekten kompatibel ist.

NXP Semiconductors hat nach eigenen Angaben Kunden, die seine Kinetis- und LPC-MCUs der unteren Preisklasse für Machine-Learning-Anwendungen einsetzen. Das Unternehmen setzt auf KI mit Hardware- und Softwarelösungen, wenn auch hauptsächlich auf seine größeren Anwendungsprozessoren und Crossover-Prozessoren (zwischen Anwendungsprozessoren und Mikrocontrollern) ausgerichtet.

Stark bewaffnet

Die meisten etablierten Unternehmen im Mikrocontroller-Bereich haben eines gemeinsam:Arm. Der Embedded-Prozessor-Core-Riese dominiert mit seiner Cortex-M-Serie den Mikrocontroller-Markt. Das Unternehmen hat kürzlich den brandneuen Cortex-M55-Kern angekündigt, der speziell für maschinelle Lernanwendungen entwickelt wurde, insbesondere in Kombination mit dem Ethos-U55-KI-Beschleuniger von Arm. Beide sind für Umgebungen mit eingeschränkten Ressourcen ausgelegt. Aber wie können Startups und kleinere Unternehmen mit den Big Playern in diesem Markt konkurrieren?

„Nicht durch den Bau von ARM-basierten SoCs, weil [die dominanten Spieler] das wirklich gut machen“, lachte Mark Lippett, CEO von XMOS. „Die einzige Möglichkeit, gegen diese Jungs anzutreten, besteht darin, einen architektonischen Vorsprung zu haben … [das bedeutet] die intrinsischen Fähigkeiten des Xcore in Bezug auf die Leistung, aber auch die Flexibilität.“

Der Xcore.ai von XMOS, sein neu veröffentlichter Crossover-Prozessor für Sprachschnittstellen, wird nicht direkt mit Mikrocontrollern konkurrieren, aber die Meinung gilt immer noch. Jedes Unternehmen, das einen Arm-basierten SoC herstellt, um mit den Großen zu konkurrieren, hat besser etwas ganz Besonderes in seiner geheimen Sauce.

>> Lesen Sie Seite zwei weiter Artikel, der ursprünglich auf unserer Schwesterseite EE Times Europe veröffentlicht wurde.

Eingebettet

- SPICE-Modelle

- Operationsverstärkermodelle

- ST-Sampling eingebetteter Phasenwechselspeicher für Automobil-Mikrocontroller

- NVIDIA:CUDA-X-KI-Computer, auf dem alle KI-Modelle ausgeführt werden

- Lebensretter

- Wie man Glasfaser herstellt

- Materialmodellierung von Metallen in Abaqus

- HPE wendet DevOps auf KI-Modelle an

- Daten in Entscheidungen umwandeln

- Anwendungen für Bearbeitungszentren. Modelle &Anwendungen?