Xilinx SOM zielt auf eine breitere Einführung von Edge-KI und eingebetteter Vision ab

Xilinx hat einen großen Schritt zur Ermöglichung einer breiteren Marktakzeptanz von Edge Artificial Intelligence (KI) und insbesondere Embedded Vision gemacht, indem es in den System-on-Module-Markt (SOM) eingestiegen ist, komplett mit vorgefertigtem Software-Stack und einem einsatzbereiten App-Store vordefinierte Anwendungen.

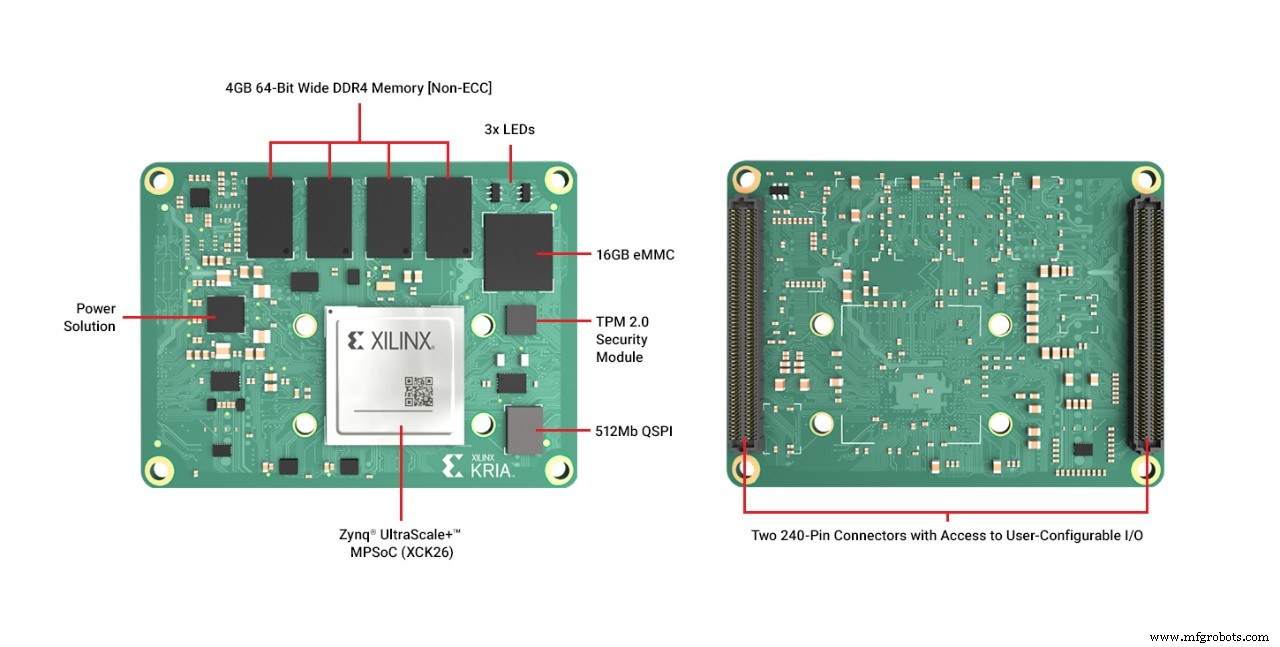

Das erste Produkt im neuen SOM-Portfolio des Unternehmens ist das Kria K26 SOM, das speziell auf Vision-KI-Anwendungen in Smart Cities und Smart Factories ausgerichtet ist, zusammen mit einem sofort einsatzbereiten, kostengünstigen Entwicklungskit, dem Kria KV260 AI Vision Starter-Kit. Das Unternehmen geht nach eigenen Angaben die steigende Komplexität der Vision-KI sowie die Herausforderungen bei der Implementierung von KI am Edge an. Daher ist der Preis für den Massenmarkt gedacht, wobei das Starter-Kit online für 199 US-Dollar verkauft wird und das Kria K26 SOM für 250 US-Dollar für eine kommerzielle Version oder 350 US-Dollar für die industrietaugliche Variante verkauft wird.

Xilinx sagte, dass die heutige KI-Vision sehr komplex ist und viele Entwickler nicht unbedingt über das Know-how auf Hardwareebene verfügen. Durch das Aufsteigen auf eine höhere Abstraktionsebene mit vorgefertigten Hardwareplattformen mit branchenüblichen Software-Stacks und einer App-Bibliothek ermöglicht es Millionen weiteren Softwareentwicklern, auf KI-Funktionen zuzugreifen, ohne dass Designkenntnisse auf Chipebene erforderlich sind.

Dies ist Teil der Kria-Entwicklungserfahrung:einen selbstgesteuerten Pfad für die Exploration, das Design und schließlich die Produktionsbereitstellung durch eine Vielzahl von Online-Ressourcen bereitzustellen. Hobbyisten, Hersteller und kommerzielle Entwickler können jede Phase des Designzyklus mit Tutorial-Videos, Schulungen und einem riesigen Ökosystem von Anbietern beschleunigen, die beschleunigte Anwendungen, Designdienste und mehr anbieten.

Zu diesem Zweck hat das Unternehmen nach eigenen Angaben stark in seine Toolflows investiert, um adaptives Computing für KI- und Softwareentwickler ohne Hardwarekenntnisse zugänglicher zu machen. Das Kria SOM-Portfolio hebt diese Zugänglichkeit auf die nächste Stufe, indem es die Hardware- und Softwareplattform mit produktionsreifen, visionsbeschleunigten Anwendungen koppelt. Diese schlüsselfertigen Anwendungen eliminieren die gesamte FPGA-Hardware-Designarbeit und erfordern nur, dass Softwareentwickler ihre benutzerdefinierten KI-Modelle, ihren Anwendungscode integrieren und optional die Vision-Pipeline modifizieren – unter Verwendung bekannter Designumgebungen wie TensorFlow, Pytorch oder Café-Frameworks sowie C , C++, OpenCL und Python-Programmiersprachen – ermöglicht durch die einheitliche Softwareentwicklungsplattform und Bibliotheken von Vitis.

Die neuen Kria-SOMs ermöglichen auch die Anpassung und Optimierung für Embedded-Entwickler mit Unterstützung für das standardmäßige Yocto-basierte PetaLinux Entwickler. Dies bietet eine breite Vertrautheit mit KI-Entwicklern und Interoperabilität mit bestehenden Anwendungen. Kunden können in beiden Umgebungen entwickeln und beide Herangehensweisen für die Produktion wählen. Beide Umgebungen werden vorgefertigt mit einer Software-Infrastruktur und hilfreichen Dienstprogrammen geliefert.

„Für Smart Vision-Anwendungen wollen Entwickler und Innovatoren die gewohnte Ubuntu-Erfahrung von der Cloud bis zum Desktop“, sagt Thibaut Rouffineau, Vice President of Marketing, Canonical/Ubuntu. „Gemeinsam mit Xilinx freuen wir uns, Kria SOM-Kunden sofort einsatzbereite Produktivität, einen reibungslosen Übergang von der Entwicklung zur Produktion und garantierte Stabilität und Sicherheit im Feld zu bieten.“

Sparen Sie 9 Monate Entwicklungszeit für das Hinzufügen von KI

Die Einführung einsatzbereiter Module und Apps ist Teil eines wachsenden Trends, um das Mysterium der Einbettung von Edge-KI und Vision-KI zu lösen und sie breiteren Endmärkten zugänglich zu machen.

Laut Jeff Bier, Analyst für Embedded Computer Vision Technologie, verfügt nicht jedes Unternehmen über eine Abteilung für maschinelles Lernen oder Computer Vision, was zu einer großen Wissens- und Kompetenzlücke bei der Implementierung von Edge-KI führt. Bier, Gründer der Edge AI and Vision Alliance, die nächsten Monat den Embedded Vision Summit 2021 abhält, erklärte kürzlich in einem Briefing mit embedded.com, dass immer mehr Anbieter bestrebt sind, Technologie zugänglich zu machen.

Als Beispiel sagte er, dass nicht viele Unternehmen die Ressourcen oder die Fähigkeiten haben, um ein Deep Neural Network (DNN) mit den Daten zu betreiben, die sie von der Kamera aufnehmen. Daher, sagte er, bieten viele Halbleiterunternehmen auch mehr Software-Referenzdesigns an.

In einer Pressekonferenz bei der Einführungsveranstaltung für die neuen SOMs sagte Chetan Khona, Director of Industrial, Vision and Healthcare bei Xilinx:„Produktionsreife Systeme sind wichtig für den schnellen Einsatz [von Embedded Vision AI]. Kunden können bis zu neun Monate Entwicklungszeit einsparen, indem sie ein modulbasiertes Design anstelle eines gerätebasierten Designs verwenden.“ Er fügte hinzu, dass Benutzer mit dem Starter-Kit innerhalb einer Stunde loslegen können, „ohne dass FPGA-Erfahrung erforderlich ist“. Dabei schließt der Nutzer Kamera, Kabel und Monitor an, steckt die programmierte microSD-Karte ein und fährt das Board hoch; dann kann der Benutzer eine beschleunigte Anwendung seiner Wahl auswählen und diese beschleunigte Anwendung ausführen.

Kirk Saban, ein leitender Angestellter von Xilinx, sagte:„Der Eintritt von Xilinx in den aufstrebenden SOM-Markt baut auf unserer Entwicklung über das Chip-Level-Geschäft hinaus auf, die mit unseren Alveo-Boards für das Rechenzentrum begann und mit der Einführung kompletter Board-Level-Lösungen für eingebettete Systeme. Saban, Vice President, Product and Platform Marketing bei Xilinx, fügte hinzu:„Das Kria SOM-Portfolio erweitert unsere Marktreichweite auf weitere Edge-Anwendungen und wird Millionen von Software- und KI-Entwicklern die Leistungsfähigkeit anpassungsfähiger Hardware zugänglich machen.“

Das Kria K26 SOM basiert auf der Zynq UltraScale+ MPSoC-Architektur, die über einen Quad-Core-Arm-Cortex-A53-Prozessor, mehr als 250.000 Logikzellen und einen H.264/265-Videocodec verfügt. Das SOM verfügt außerdem über 4 GB DDR4-Speicher und 245 IOs, wodurch es sich an praktisch jeden Sensor oder jede Schnittstelle anpassen kann. Xilinx sagte mit 1,4 Tera-Ops KI-Computing, das Kria K26 SOM ermöglicht es Entwicklern, Vision-KI-Anwendungen zu erstellen, die im Vergleich zu GPU-basierten SOMs eine mehr als dreimal höhere Leistung bei geringerer Latenz und Energie bieten, was für intelligente Bildverarbeitungsanwendungen wie Sicherheit, Verkehr und . von entscheidender Bedeutung ist Stadtkameras, Retail Analytics, Machine Vision und Vision Guided Robotics.

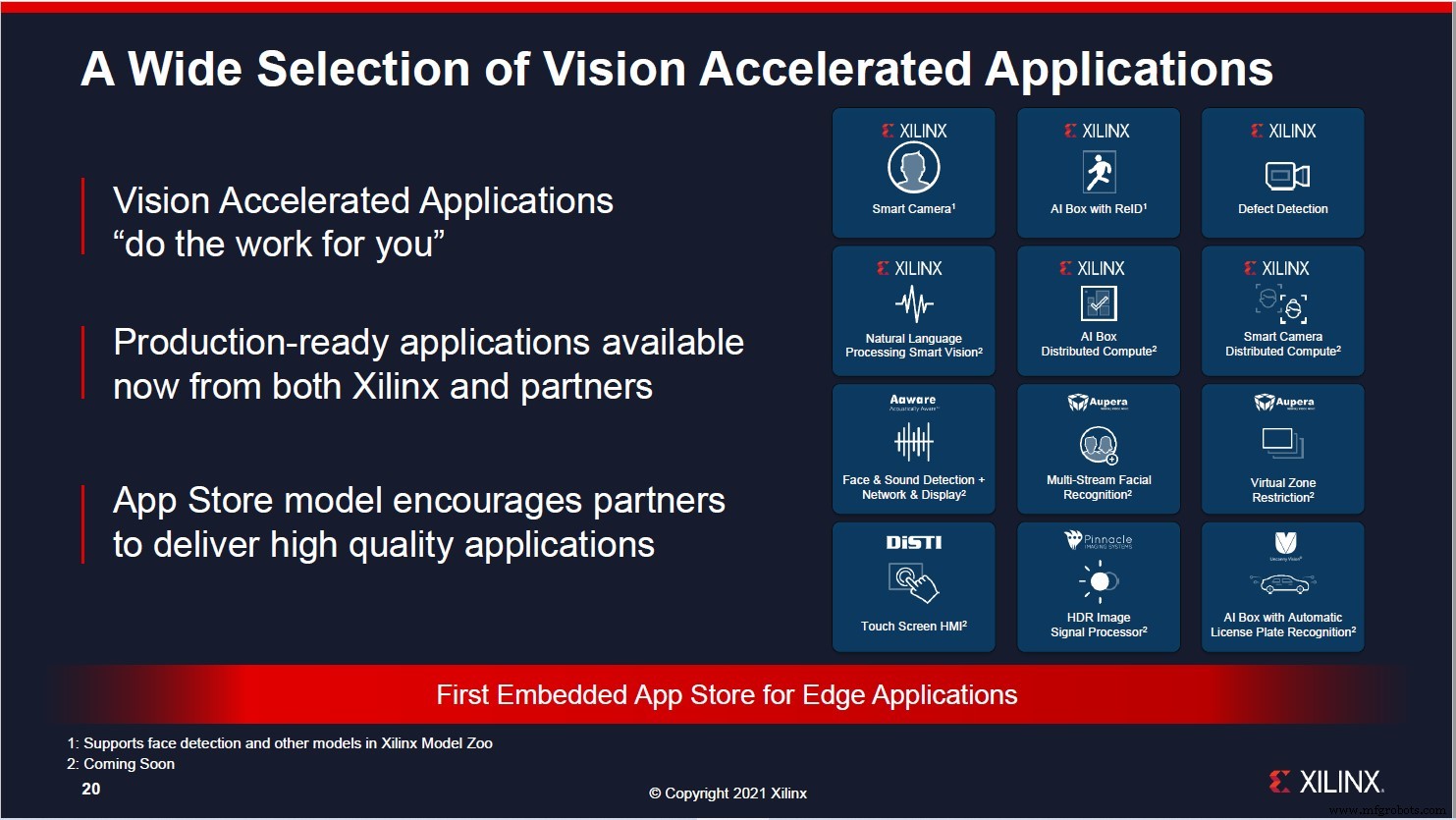

Als Teil des neuen Ansatzes, beschleunigte Anwendungen für softwarebasiertes Design anzubieten, kündigte Xilinx auch den ersten eingebetteten App Store für Edge-Anwendungen an. Über seinen Alveo-App-Katalog für Rechenzentren hinausgehend, bietet der Xilinx App Store Kunden jetzt eine große Auswahl an Apps für Kria SOMs von Xilinx und seinen Ökosystempartnern. Khona erklärte weiter:„Wir bauen die Anwendungsbibliothek auf. Der App Store ist noch nicht automatisiert, daher müssen Sie sich an den IP-Anbieter wenden [wenn er von einem Ökosystempartner stammt].“ Bei den direkt von Xilinx verfügbaren Apps handelt es sich um beschleunigte Open-Source-Anwendungen, die kostenlos bereitgestellt werden und von der intelligenten Kameraverfolgung und Gesichtserkennung bis hin zur Verarbeitung natürlicher Sprache mit Smart Vision reichen.

Xilinx hob einige frühe Anwendungen hervor, die das Kria SOM bereits bereitgestellt haben. Dazu gehört auch Kutleng Engineering Technologies, die Tracking-Kameras für die Sicherheit von Wildtieren in Südafrika einsetzen konnten. Kutleng sagte, es sei in der Lage gewesen, die Einführung mehrerer neuer Produkte innerhalb von nur zwei Monaten zu beschleunigen, indem es Visionsfunktionen nutzte, die über die beschleunigten Anwendungen von Xilinx verfügbar sind. Darüber hinaus hat Optimized Solutions Limited in Indien mithilfe des Kria SOM eine KI-basierte Vision für die Erkennung, Erkennung und Identifizierung mehrerer Objekte für eine Smart-City-Anwendung bereitgestellt.

Eingebettet

- Grundlagen eingebetteter Systeme und Anwendungen

- Was sind eingebettete Systeme und ihre Echtzeitanwendungen

- 5G und GaN:Was Embedded-Designer wissen müssen

- ST treibt KI zu Edge- und Node-Embedded-Geräten mit STM32 Neural-Network Developer Toolbox

- MCUs zielen auf sichere IoT-Endpunkt- und Edge-Designs ab

- TRS-STAR:robuste und lüfterlose Embedded-Systeme von avalue

- congatec führt 100-Watt-Ökosystem für eingebettete Edge- und Mikroserver ein

- Smart-Kamera bietet schlüsselfertige Edge Machine Vision Edge-KI

- Eingebettete Systeme und Systemintegration

- Open Source fördert die Einführung von IoT und Edge Computing