Fehlersichere KI-Algorithmen

Störungen bei Bildverarbeitungskameras, unkalibrierten Sensoren oder unvorhersehbaren Schatten können zu potenziell kostspieligen und gefährlichen Fehlern in industriellen KI-Systemen führen. Die Forscher entwickeln jedoch Algorithmen zur Fehlersicherung sowie einfache Maßnahmen, mit denen sich die Fehlerwahrscheinlichkeit verringern lässt.

Künstliche Intelligenz hat sich weit über das grundlegende künstliche neuronale Perceptron-Netzwerk hinaus entwickelt, aber Fehler bleiben ein Problem. Bild mit freundlicher Genehmigung von Pixabay

Industrielle Anwendungen für künstliche Intelligenz

Es gibt zahlreiche industrielle Anwendungen für KI (Künstliche Intelligenz), wie zum Beispiel Robotikplattformen, Materialhandhabung, Verpackung, Maschinenbedienung, Montage, Inspektion und BAS (Gebäudeautomatisierungssysteme). Konkretere Beispiele sind Drohnen- und Schwarmtechnologie zum Sortieren, Bewegen und Transportieren von Gegenständen oder das Erkennen von Anomalien in Produktionsprozessen.

KI ist zu einem kritischen, aber oft vergessenen Aspekt der industriellen Automatisierung geworden, der auf maschinelles Sehen, Roboterarme, Fernerkundung und Prozesssteuerung angewiesen ist.

KI-Tools sind jedoch keine einfache Blackbox, in die Daten als Eingabe bereitgestellt und in eine genaue Ausgabe umgewandelt werden. Manchmal ist die Ausgabe falsch, und das gibt Anlass zur Sorge.

Fehlerarten in industriellen Anwendungen

Computer tun, was ihnen gesagt wird, also ist ein Mensch die Wurzel jedes Fehlers. Es kann ein Konstruktionsfehler, ein Algorithmusfehler, ein Konstruktionsfehler oder schlechte Daten sein, aber an der Wurzel steckt ein Mensch.

Dies gilt auch für KI, einschließlich industrieller KI. Fehler in der industriellen KI können in eine von zwei Kategorien fallen:algorithmischer Bias und maschineller Bias.

Die algorithmische Verzerrung beinhaltet Fehler, die sowohl wiederholbar als auch systembedingt sind. Solche Fehler können sich auf verschiedene Weise manifestieren:inhärenter Fehler in der Logik des Algorithmus, unerwartete Verwendung der Ausgabe des Algorithmus oder Probleme mit den dem KI-System bereitgestellten Daten.

Maschinenfehler treten auf, wenn ein begrenzter Datensatz zum Trainieren des Systems verwendet wird, was zu einer fehlerhaften Ausgabe führt.

Die Bedeutung der Kontrolle von KI-Fehlern

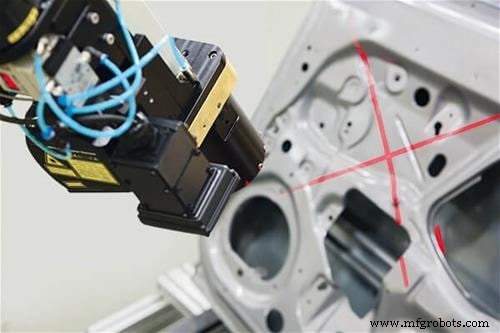

Betrachten Sie als Beispiel für algorithmische Verzerrungen ein KI-gestütztes Bildverarbeitungssystem, das für automatisierte Qualitätskontrollsysteme verwendet wird. Eine solche Anwendung hängt stark von genauen Messungen ab, die als Daten an die KI geliefert werden, um festzustellen, ob das Teil innerhalb der Toleranzen liegt. Wenn der KI ungenaue Messungen zur Verfügung gestellt werden, führt dies zu einer fehlerhaften Teilebeschriftung.

Die Algorithmen hinter der KI für maschinelles Sehen können zu 100 % korrekt sein, aber schlechte Daten bedeuten eine schlechte Ausgabe. Akzeptable Teile können entsorgt werden, während minderwertige Teile an Kunden weitergesendet werden können. Dies führt zu unnötigen Kosten und Ausfallzeiten, da die Ursache des Problems aufgespürt wird.

Der iRVision 3DL von FANUC verwendet Laser und KI, um den Oberflächenzustand eines Teils zu überprüfen. Bild mit freundlicher Genehmigung von FANUC

Einige KI-Systeme, die vor der Verwendung in einer bestimmten Umgebung oder Anwendung eine Schulung erfordern. In solchen Fällen sind die dem System zur Verfügung gestellten Trainingsdaten äußerst wichtig. Wenn ein System beispielsweise nur auf Bedingungen in einem beleuchteten Bereich trainiert wird, treten Probleme auf, wenn das System ohne Licht funktionieren muss.

Fehlersichere KI (Trainings-KI)

Da hinter KI und maschinellem Lernen ein menschliches Element steckt, kann es nicht fehlersicher gemacht werden. Es gibt jedoch Möglichkeiten, Fehler innerhalb von KI-Systemen zu minimieren. Ein Beispiel ist CARRL (Certified Adversarial Robustness for Deep Reinforcement Learning), ein am MIT entwickelter Deep-Learning-Algorithmus, dessen Zweck es ist, autonome Systeme zu unterstützen, indem eine gewisse Skepsis gegenüber den berücksichtigten Daten wie Rauschen in den Daten und feindliche Bemühungen, das System zu verwirren.

Carnegie Mellon hat auch an einem KI-Algorithmus für Deep-Learning-Modelle gearbeitet. Dieser als RATT (Randomly Assign, Train and Track) bezeichnete Ansatz verwendet nicht gekennzeichnete und verrauschte Trainingsdaten, um eine Obergrenze für das wahre Fehlerrisiko festzulegen. Diese Obergrenze kann dann bestimmen, wie gut sich ein KI-Modell an neue Eingabedaten anpasst. Darüber hinaus haben Forscher in Princeton Algorithmen untersucht, die es einem KI-System ermöglichen, effektiv zu lernen, wenn Fehler in den Trainingsdaten vorhanden sind.

Es gibt auch Standards in der Entwicklung, die sich auf die Bemühungen zur Fehlervermeidung auswirken werden. Das NIST (National Institute of Standards and Technology) trägt aktiv zu KI-Standards bei, die sich auf die Bewertung der Vertrauenswürdigkeit von KI-Technologie konzentrieren. NIST hat auch einen Ansatz vorgeschlagen, um das Risiko von Verzerrungen in KI-Systemen zu reduzieren.

Die US-amerikanische CISA (Cybersecurity and Infrastructure Security Agency) untersucht bereits Standards für die Überprüfung von KI-Algorithmen und Datenerfassung, wie im Rahmen eines Panels mit dem Titel „Genius Machines“ im Jahr 2020 bekannt gegeben wurde. Diese Bemühungen, zusammen mit denen von NIST, betonen die Rechenschaftspflicht.

Adressierungsfehler in KI-Systemen

Auch wenn die Fehlersicherheit der KI-Systeme, für die Sie verantwortlich sind, aufgrund des beteiligten menschlichen Elements möglicherweise nicht möglich ist, gibt es sicherlich Möglichkeiten, die Möglichkeit von Fehlern zu minimieren.

Wenn Sie vermuten, dass Fehler von Ihrem KI-System stammen, geben Sie nicht automatisch dem Algorithmus die Schuld; Studieren Sie stattdessen die Fehler, um nach einem Muster zu suchen. Wenn es sich beispielsweise um einen autonomen Kommissionierroboter handelt, der Fehler macht, prüfen Sie, ob die falsch sortierten Artikel Gemeinsamkeiten aufweisen oder ob Änderungen in der Umgebung des Roboters (Beleuchtung, Schatten usw.) vorliegen, die seine Leistung beeinträchtigen könnten . Es könnte auch ein Problem mit einer verschmutzten Kameralinse im Machine-Vision-Teil des Systems vorliegen, wie sie beispielsweise bei autonomen mobilen Robotern zu finden ist.

Viele Bildverarbeitungskameras verfügen über integrierte KI-Systeme wie die FLIR Firefly DL, aber diese Systeme können Fehler generieren, wenn sie nicht sauber gehalten und richtig konfiguriert werden. Bild mit freundlicher Genehmigung von FLIR

Eine harte Programmierregel lautet, dass eine schlechte Eingabe immer zu einer schlechten Ausgabe führt. Der erste Schritt zur Minimierung des Fehlers, der von einem industriellen KI-System erzeugt wird, besteht darin, sicherzustellen, dass seine Daten, angefangen bei den Sensoren, so genau wie möglich sind. Die Sensoren, die Eingangsdaten an KI-Systeme liefern, sollten regelmäßig kalibriert werden.

Werkzeuge innerhalb des KI-Systems, die es Benutzern ermöglichen, akzeptable Bereiche für Daten festzulegen, sollten nach sorgfältiger Prüfung eines akzeptablen Bereichs implementiert werden:zu streng, und die KI bietet keinen großen Nutzen; zu locker, und es erzeugt viel zu viele Fehler. Und denken Sie daran, diese Werte können angepasst werden.

Halten Sie auch, wie bereits erwähnt, alle Kameras sauber. Bildverarbeitungssysteme sind zwar so konzipiert, dass sie unter verschiedenen Umgebungsbedingungen robust sind, aber das bedeutet nicht, dass sie auch dann noch gut funktionieren, wenn die Sicht durch eine verschmutzte Linse beeinträchtigt wird. Dasselbe gilt für andere Industriesensoren, deren Genauigkeit durch Ablagerungen, korrosive Umgebungen, mechanische Probleme oder Alterung beeinträchtigt werden kann.

KI ist in der Industrie weit verbreitet für alles von Prozesskontrollen bis hin zu Qualitätsprüfungen. Und aufgrund des menschlichen Faktors sind diese KI-Systeme auch fehleranfällig. Fehlersichernde Algorithmen werden entwickelt, aber diese Methoden sind noch nicht vollständig ausgereift und wurden auch nicht ausgiebig in industriellen Anwendungen getestet. Und während Organisationen wie NIST und CISA an Standards zur Fehlersicherheit arbeiten, befinden sie sich noch in der Entwicklung. Einige einfache Maßnahmen können jedoch die Fehlerwahrscheinlichkeit in Ihren KI-Systemen reduzieren.

Industrieroboter