Edge-Computing-Herausforderungen und wie man sie löst

Da intelligente Autos, Smart-Home-Geräte und vernetzte Industrieanlagen sowohl an Zahl als auch an Popularität zunehmen, erzeugen sie praktisch überall Daten. Tatsächlich gibt es im Jahr 2022 weltweit mehr als 16,4 Milliarden vernetzte IoT-Geräte (Internet of Things), und die Zahl wird voraussichtlich bis 2025 auf 30,9 Milliarden ansteigen. Bis dahin prognostiziert IDC, dass diese Geräte weltweit 73,1 Zettabyte an Daten generieren werden, was ist ein Wachstum von 300 % im Vergleich zum nicht allzu fernen Jahr 2019.

Das schnelle und effektive Sortieren und Analysieren dieser Daten ist der Schlüssel sowohl für eine optimale Anwendungsbenutzererfahrung als auch für eine bessere Geschäftsentscheidung. Edge-Computing ist die Technologie, die dies ermöglicht.

Die Bereitstellung moderner Workloads wie Microservices, Apps für maschinelles Lernen und KI in der Nähe des Edge bringt jedoch eine Reihe von Herausforderungen mit sich, die die Infrastruktur eines Unternehmens bewältigen muss. Um vom Edge-Computing zu profitieren, müssen Unternehmen ein perfektes Gleichgewicht zwischen ihrer IT-Infrastruktur und den Anforderungen ihrer Endnutzer finden.

Herausforderungen des Edge-Computing

Für eine optimale Leistung erfordern Edge-Workloads Folgendes:

- Nähe – Speicher- und Rechenressourcen müssen sich in der Nähe der Datenquelle befinden.

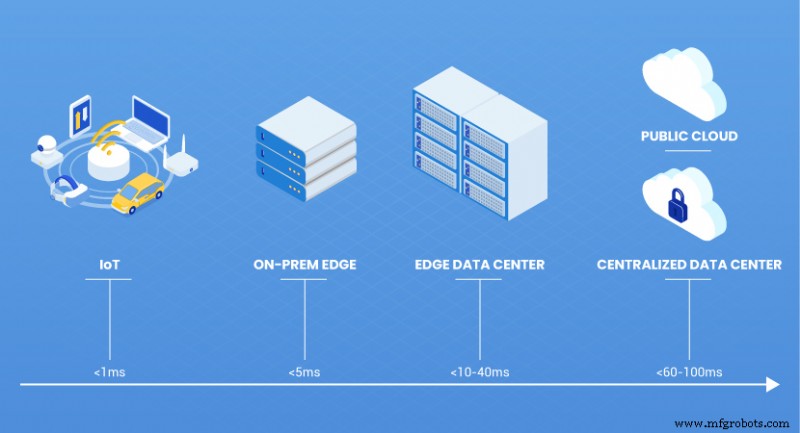

- Reaktionsfähigkeit – Apps benötigen Datenübertragungslatenzen von unter 5 auf 20 Millisekunden.

- Mobilität – Viele Edge-Geräte bewegen sich und Rechen- und Speicherressourcen müssen folgen.

Die Datenübertragungslatenz des Remote- und zentralisierten öffentlichen Cloud-Computing-Modells entspricht nicht den Anforderungen moderner Edge-Workloads. Andererseits ist der Aufbau eines dezentralisierten Netzwerks zur Unterstützung von Edge-Workloads mit einer einschüchternden Liste eigener Herausforderungen verbunden.

Logistische Komplexität

Die Verwaltung unterschiedlicher Edge-Computing-, Netzwerk- und Speichersysteme ist komplex und erfordert die gleichzeitige Verfügbarkeit erfahrener IT-Mitarbeiter an mehreren geografischen Standorten. Dies kostet Zeit und stellt eine erhebliche finanzielle Belastung für Unternehmen dar, insbesondere wenn Hunderte von Container-Clustern mit unterschiedlichen Microservices betrieben werden, die von verschiedenen Edge-Standorten zu unterschiedlichen Zeiten bereitgestellt werden.

Bandbreitenengpässe

Laut einem Bericht von Morgan Stanley sollen allein Radare, Sensoren und Kameras von autonomen Fahrzeugen bis zu 40 TB Daten pro Stunde generieren. Um lebensrettende Entscheidungen schnell treffen zu können, müssen die Daten, die diese vierrädrigen Supercomputer erzeugen, innerhalb von Sekundenbruchteilen übertragen und analysiert werden.

Ebenso sammeln und verarbeiten zahlreiche Edge-Geräte gleichzeitig Daten. Das Senden solcher Rohdaten an die Cloud kann die Sicherheit gefährden und ist oft ineffizient und unerschwinglich.

Um die Bandbreitenkosten zu optimieren, weisen Organisationen den Rechenzentren in der Regel eine höhere und den Endpunkten eine geringere Bandbreite zu. Dies macht die Uplink-Geschwindigkeit zu einem Engpass bei Anwendungen, die Daten von der Cloud an den Rand schieben, während die Randdaten gleichzeitig in die andere Richtung gehen. Wenn die Edge-Infrastruktur wächst, nimmt der IoT-Datenverkehr zu und unzureichende Bandbreite verursacht massive Latenzen.

Eingeschränkte Leistungsfähigkeit und Skalierungskomplexität

Der kleinere Formfaktor von Edge-Geräten führt in der Regel zu einem Mangel an Leistung und Rechenressourcen, die für erweiterte Analysen oder datenintensive Workloads erforderlich sind.

Außerdem macht die dezentrale und heterogene Natur des Edge-Computing die Skalierung der physischen Infrastruktur zu einer großen Herausforderung. Skalierung am Rand bedeutet nicht nur, mehr Hardware an der Datenquelle hinzuzufügen. Vielmehr erstreckt es sich auf die Skalierung von Personal, Datenmanagement, Sicherheit, Lizenzierung und Überwachung von Ressourcen. Wenn eine solche horizontale Skalierung nicht richtig geplant und ausgeführt wird, kann dies zu erhöhten Kosten aufgrund von Overprovisioning oder einer suboptimalen Anwendungsleistung aufgrund unzureichender Ressourcen führen.

Datensicherheit

Da die Datenverarbeitung an den Rand verlagert wird, geht die Infrastruktur über die mehreren physischen und virtuellen Ebenen der Netzwerksicherheit hinaus, die von zentralisierten Datenverarbeitungsmodellen geboten werden. Wenn der Edge nicht ausreichend geschützt ist, wird er zum Ziel verschiedener Cyber-Bedrohungen.

Böswillige Akteure können nicht autorisierten Code einschleusen oder sogar ganze Knoten replizieren, Daten stehlen und sie manipulieren, während sie unter dem Radar fliegen. Sie können auch Daten stören, die über das Netzwerk übertragen werden, indem sie Angriffe auf Routing-Informationen durchführen, die Durchsatz, Latenz und Datenpfade durch Löschen und Ersetzen von Daten beeinträchtigen. Eine weitere häufige Bedrohung der Datensicherheit am Edge sind DDoS-Angriffe, die auf überwältigende Knoten abzielen, um den Akku zu entladen oder Kommunikations-, Rechen- und Speicherressourcen zu erschöpfen. Von allen Daten, die IoT-Geräte sammeln, müssen nur die kritischsten Daten analysiert werden. Ohne sichere und konforme langfristige Datenaufbewahrungs- und Archivierungslösungen führt dies häufig zu einer übermäßigen Datenanhäufung und Datenflut am Rand, was die Anfälligkeit weiter erhöht.

Datenzugriffskontrolle

Die Tatsache, dass Edge-Geräte physisch isoliert sind, bedeutet, dass Daten in diesem verteilten Computersystem von verschiedenen Geräten verarbeitet werden, was die Sicherheitsrisiken erhöht und die Überwachung, Authentifizierung und Autorisierung des Datenzugriffs erschwert.

Die Privatsphäre eines Endbenutzers oder Endgeräts ist ein weiterer kritischer Aspekt, den es zu wahren gilt. Es sind mehrstufige Richtlinien erforderlich, um sicherzustellen, dass jeder Endbenutzer berücksichtigt wird. Dies zu ermöglichen und gleichzeitig die Anforderungen an die Datenlatenz in Echtzeit zu erfüllen, ist eine große Herausforderung, insbesondere beim Aufbau einer Edge-Infrastruktur von Grund auf.

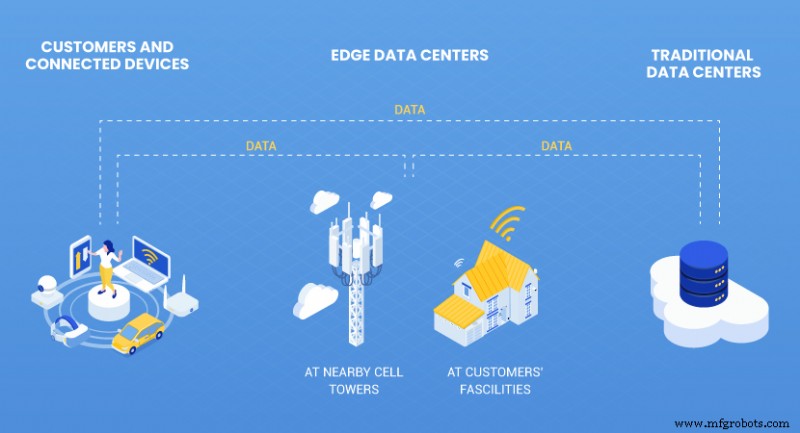

Eine physisch nahe gelegene, vorkonfigurierte Lösung, die von einem Ökosystem von Partnern entwickelt wurde, die optimierte Hardware- und Infrastrukturverwaltungstools anbieten, mindert die Herausforderungen des Edge-Computing. Edge-Rechenzentren sind eine aufkommende Lösung, die dieses Problem angeht, indem sie Unternehmen hochleistungsfähige Datenspeicher- und -verarbeitungsressourcen in einem sicheren und schnellen Netzwerk bieten.

Edge-Infrastruktur zur Rettung

Im Vergleich zur Cloud befindet sich die Edge-Infrastruktur in kleineren Einrichtungen in der Nähe des Endbenutzernetzwerks. Indem Rechen-, Speicher- und Netzwerkressourcen näher an die Datenquelle gebracht werden, bieten Edge-Rechenzentren verschiedene Vorteile für Unternehmen und ihre Workloads.

Dazu gehören:

- Minimierte Latenz durch physische Nähe – Verbesserung der Datenbereitstellung und Verkürzung der Reaktionszeit von Anwendungen.

- Verbesserte Sicherheit und Datenschutz – Hohes Maß an physischer und Cyber-Sicherheit vor Ort, weniger Daten, die in die Cloud hochgeladen werden, und eine geringere Menge an gefährdeten Daten während der Übertragung.

- Erhöhte Zuverlässigkeit – Die Umverteilung von Workloads auf kleinere Rechenzentren entlastet zentrale Server und erhöht die Leistung und Datenverfügbarkeit.

- Kostenoptimierung – Mit Managed Services und vorkonfigurierten Infrastrukturlösungen helfen Edge-Rechenzentren Unternehmen dabei, die Gesamtbetriebskosten zu senken und die IT-Kosten zu senken.

Als globaler IaaS-Anbieter erkennt phoenixNAP an, wie wichtig es ist, leistungsstarke Rechen- und Speicherressourcen nahe an den Rand zu bringen und sie weltweit leicht zugänglich und skalierbar zu machen. Um die Verfügbarkeit unserer Bare-Metal-Cloud-Plattform weiter auszubauen, haben wir uns mit American Tower zusammengetan, um unseren ersten Edge-Standort in Austin, Texas, zu eröffnen. Dadurch erhalten Benutzer im Südwesten der USA Zugriff auf die folgenden Funktionen:

- Vorkonfigurierte, API-gesteuerte dedizierte Server, die innerhalb von Minuten bereitgestellt werden und in 10 Millisekunden verfügbar sind.

- Zugriff auf 5G zur Unterstützung zukunftsfähiger Edge-Workloads.

- Automatisiertes Infrastrukturmanagement durch zertifizierte IaC-Tools (Terraform, Ansible, Pulumi).

- Mehrere private Konnektivität auf virtueller Ebene 3 mit Megaport Cloud Router (MCR).

- 15 TB freie Bandbreite in einem 20-Gbit/s-Netzwerk mit kostenlosem DDoS-Schutz.

- Hochgeschwindigkeits-NVMe-Speicher und einfacher Zugriff auf Petabyte an S3-kompatiblem Cloud-Objektspeicher.

- Flexible Abrechnungs- und Bandbreitenoptionen mit Rabatten für monatliche oder jährliche Reservierungen.

Durch leistungsstarke Hardware- und Softwaretechnologien, die als Service angeboten werden, helfen Plattformen wie Bare Metal Cloud Unternehmen, die Reaktionszeit zu verkürzen und Engpässe bei der Datenübertragung zu vermeiden. Edge-Workloads profitieren von der automatisierungsgesteuerten Infrastrukturbereitstellung und Unterstützung für containerisierte Anwendungen und Microservices. Gleichzeitig ermöglichen sichere Single-Tenant-Ressourcen und Single-Pane-of-Glass-Überwachung und -Zugriff eine vollständige Kontrolle der Infrastruktur. Schließlich werden durch die Nutzung vorkonfigurierter Server Rack-, Stromversorgungs-, Kühlungs-, Sicherheits- oder andere Wartungsfaktoren für die Infrastruktur überflüssig, sodass sich interne Teams stattdessen auf die Anwendungsoptimierung konzentrieren können.

Schlussfolgerung

Drahtlose Kommunikationstechnologien, IoT-Geräte und Edge-Computing entwickeln sich ständig weiter, verlocken sich gegenseitig zu neuen Durchbrüchen und schaffen gleichzeitig neue Herausforderungen, die es zu bewältigen gilt. Da immer mehr Daten generiert und im gesamten IoT-Ökosystem verteilt werden, müssen Rechen-, Speicher- und Netzwerktechnologien folgen und sich an die Anforderungen der Workloads der Zukunft anpassen. Durch Partnerschaften zwischen verschiedenen IT-Anbietern und Dienstleistern entstehen Lösungen wie Edge-Rechenzentren. Indem sie eine sichere, leistungsstarke Datenübertragung, Speicherung und Analyse direkt am Geburtsort der Daten bereitstellen, helfen sie Unternehmen, ihre Probleme mit dem Edge-Computing zu überwinden.

Cloud Computing

- Wie Edge Computing der Unternehmens-IT zugute kommen könnte

- Big Data und Cloud Computing:Eine perfekte Kombination

- Cloud und wie sie die IT-Welt verändert

- Einsatz von Big Data und Cloud Computing in Unternehmen

- Edge Computing:5 potenzielle Fallstricke

- Was ist Edge Computing und warum ist es wichtig?

- Näher am Edge:Wie Edge Computing Industrie 4.0 vorantreiben wird

- Blockchain und Edge Computing:Aufladen der Lieferkette

- Sieben Last-Mile-Lieferherausforderungen und wie man sie löst

- Edge-Computing und 5G skalieren das Unternehmen